Expertos demandan más rapidez y principios éticos para regular la inteligencia artificial

Así va la carrera entre Estados Unidos, China y la Unión Europea por regular los principios y límites de esta nueva revolución tecnológica

madrid

Que la tecnología va por delante de la ley no es ninguna novedad. Y en el caso de la Inteligencia Artificial también está ocurriendo algo parecido. Esta nueva revolución tecnológica ya está presente en sectores como la sanidad, la logística o el arte, pero el problema que tienen muchos gobiernos es que los trámites para aprobar las normas van más lentos que los algoritmos.

Aquí vamos a hacer un repaso de cómo está la regulación en diferentes países, y si estas futuras normas dibujan una inteligencia artificial justa e inclusiva.

La Unión Europea tendrá ley, como pronto, a mitad de 2024

Esta es la fecha que manejan expertos como Lucía Ortiz de Zárate, investigadora de Ética y Gobernanza de la Inteligencia Artificial en la Universidad Autónoma de Madrid. Ortiz de Zárate asegura a la Cadena SER que “La Unión Europea lleva trabajando desde 2018 en el desarrollo de una norma comunitaria para gobernar de forma ética la inteligencia artificial en suelo europeo. En 2021 propuso la primera regulación a nivel mundial en esta tecnología, una normativa que se espera que entre en vigor, como pronto, en la primera mitad de 2024”, asegura esta experta.

Esta primera normativa se aprobó en marzo de 2021 para regular los usos de la inteligencia artificial y abordar adecuadamente los beneficios y los riesgos de su uso. El reglamento pretende crear un especio seguro para la innovación de esta tecnología definiendo varios niveles de protección del interés público, la seguridad y la defensa de los derechos fundamentales y la creación de un ecosistema confiable.

¿Cuáles son las claves de esta nueva regulación?

La vicepresidenta Margrethe Vestager ha dicho que “en Inteligencia Artificial, la confianza es imprescindible, no un lujo”. La Comisión Europea aspira a fijar los estándares internacionales en el sector de la Inteligencia Artificial como ya hiciera con el Reglamento de Protección de Datos. Cuando se apruebe el reglamento será de aplicación en todos los Estados Miembros, y en todos los sectores públicos y privados tanto dentro como fuera de la UE. Esto significa que afectará a un banco que trabaje con esta tecnología o una empresa de reclutamiento de personal.

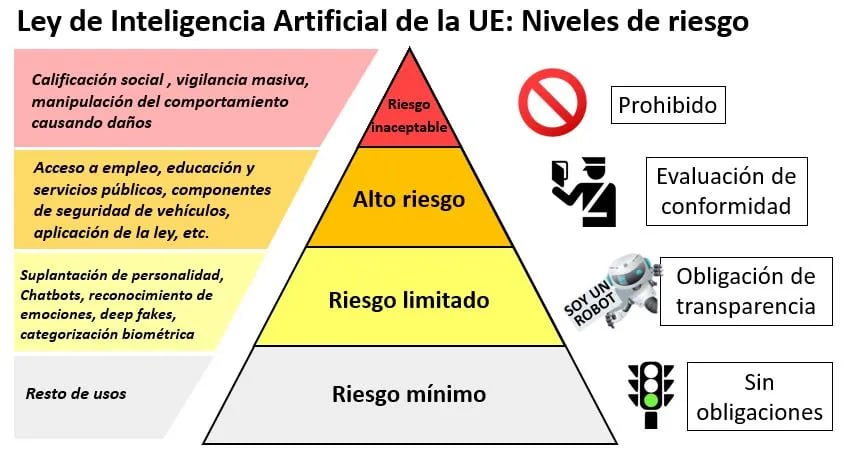

Hay cuatro niveles de riesgo

Se han establecido 4 categorías: “riesgo inadmisible”, “riesgo máximo”, “riesgo limitado” y “riesgo mínimo”. La primera categoría prohibirá los sistemas que sirven para manipular el comportamiento humano como la “puntuación social” que utiliza China para controlar a sus ciudadanos. Los de “alto riesgo” se refieren a sistemas que filtran currículos para la contratación de candidatos, estudios de clasificación crediticia para conceder préstamos o sistemas inteligentes de transporte que pueden poner en peligro las infraestructuras críticas.

La vigilancia masiva de ciudadanos sin límites o la identificación biométrica también están contempladas en esta normativa. Se prohíbe la identificación biométrica remota por parte de la policía en espacios públicos a través del reconocimiento facial. En este punto hay excepciones cuando lo ordena un juez u otro órgano independiente, pero con límites temporales, geográficos y de datos en esta investigación.

Foto de los niveles de riesgo decretados por la Unión Europea en el uso de la Inteligencia Artificial / Telefónica

Foto de los niveles de riesgo decretados por la Unión Europea en el uso de la Inteligencia Artificial / Telefónica

Los robots conversacionales también tienen límites

Los robots conversacionales serán definidos como “riesgo limitado”. Las empresas que los usen deberán ser transparentes al determinar los fines que tiene esta recogida de datos. Además, las compañías que usen estos ‘bots’ deben garantizar que el ciudadano es consciente de que esta hablando con una máquina para poder tomar una decisión informada.

La Unión Europea penalizará a las empresas que incumplan el reglamento con sanciones de hasta un 6% de su facturación global o 30 millones de euros, según sea la cifra más alta.

La regulación ética, un elemento imprescindible

La UNESCO ha hecho recomendaciones sobre cómo debe ser el uso ético de estas nuevas tecnologías. Esta organización aboga por un uso “seguro, justo e inclusivo”. Propone 10 principios que recogen la necesidad de que esta tecnología “sea equitativa y no genere discriminación”; también recuerda que las personas tienen derecho a saber cuándo se toma una decisión en base a algoritmos de Inteligencia Artificial y en el área de género aboga por “aumentar la diversidad en el campo de la IA y garantizar que las mujeres y las niñas estén representadas en el desarrollo de estas herramientas y se beneficien por igual de la tecnología”.

En esta línea, la experta Lucía Ortiz de Zárate asegura que la nueva regulación que está preparando Europa “pretende compatibilizar el uso de tecnologías de inteligencia artificial con los derechos y libertades de la ciudadanía europea”.

Joe Bien acelera la regulación

Estados Unidos ha establecido 10 principios para establecer sistemas eficaces y seguros de IA. Así, deberán someterse a pruebas previas a su despliegue y evitar el uso de datos que no sean necesarios para los fines que se pretenden. Debe evitarse también que los algoritmos creen sesgos de raza, color, origen étnico, religión o edad, entre otros.

El tercer principio exige la protección de datos contra prácticas abusivas. Asimismo, se debe proporcionar a los ciudadanos información adecuada y clara sobre los sistemas automatizados que utilicen. Otra de las obligaciones tiene que ver con el derecho de los ciudadanos a impugnar una decisión automatizada y , además, solicitar la intervención humana en caso de problemas.

Una diferencia respecto a la futura ley europea es que Estados Unidos quiere dictar normas diferentes para cada sector que trabaje con estas tecnologías mientras que la Unión Europea propone una norma más general.

China quiere controlar el algoritmo de las grandes tecnológicas

China también ha acelerado en el último año la regulación de la Inteligencia Artificial. En octubre de 2021 aprobó varias directrices éticas para proteger al usuario y darle mayor control sobre las plataformas tecnológicas. Los seis principios básicos para los sistemas de IA apuntan a que deben ser “controlables y confiables”, así como mejorar el bienestar humano, promover la equidad y la justicia, proteger la privacidad y la seguridad, además de aumentar la educación ética.

Según los analistas, detrás de estos principios, está la intención del gobierno de ejercer un mayor control del panorama tecnológico del país. Un ejemplo de esto es moderar los contenidos de recomendación para evitar la recogida masiva de datos. China pretende ser líder en la regulación de la inteligencia artificial a finales de esta década.

Nieves Goicoechea

La mayor parte de mi carrera la he desarrollado en la radio. También “conocí el poder por dentro” como...