Medio siglo después, '2001: Una odisea del espacio' aún nos ayuda a comprender el futuro

La película nació de la colaboración entre el escritor de ciencia ficción Arthur C. Clarke y el director de cine Stanley Kubrick

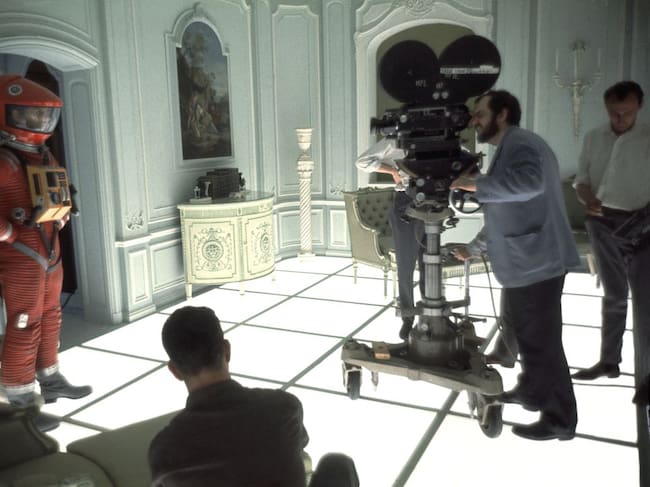

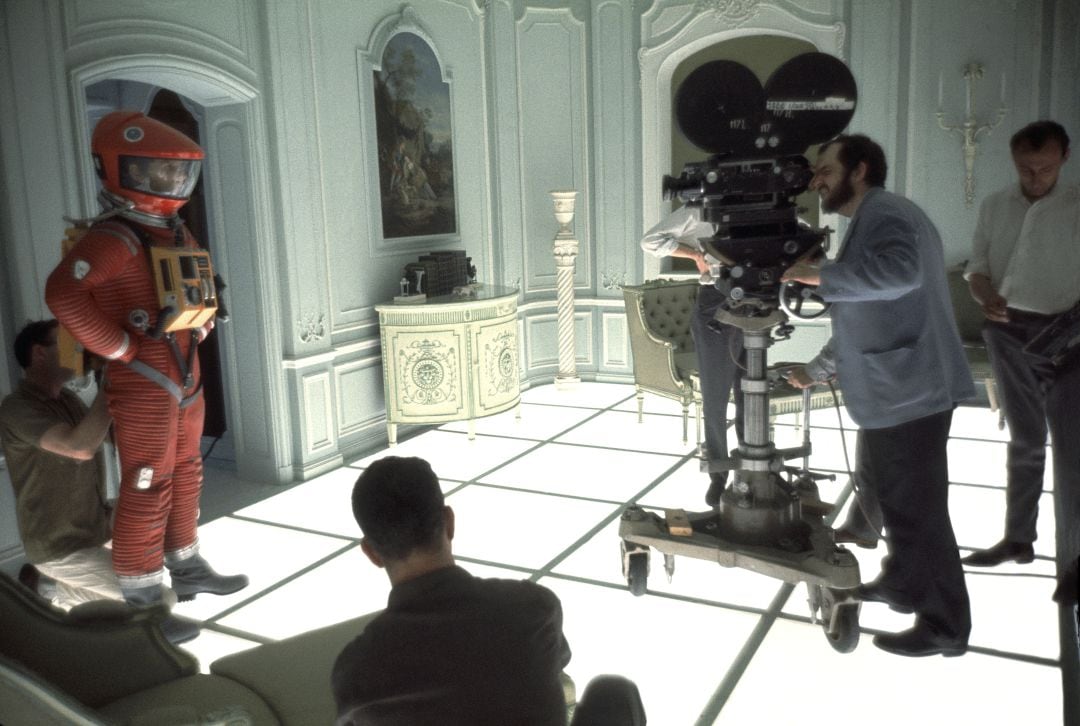

Stanley Kubrick, durante el rodaje de '2001: una odisea en el espacio' en 1966. Dentro del traje espacial está el actor americano Keir Dullea. / Keith Hamshere/Getty Images

Durante una proyección especial por el 50 aniversario de 2001: Una odisea del espacio, yo, matemático y científico computacionaldedicado a la investigación en el área de la Inteligencia Artificial, no pude evitar ponerme a comparar el mundo actual con el futuro que predijo la película.

La película nació de la colaboración entre el escritor de ciencia ficción Arthur C. Clarke y el director de cine Stanley Kubrick, y está inspirada en la novela El fin de la infancia de Clarke y en un cuento menos conocido del mismo autor: El centinela.

Esta obra constituye un impresionante trabajo de ficción especulativa que construye un futuro alentador a la par que aleccionador en el que se producen contactos alienígenas, y los viajes interplanetarios y las máquinas con consciencia son posibles. Se trata de un futuro en el que la humanidad da el siguiente gran salto evolutivo.

Así comienza la banda sonora de ‘2001: A Space Odyssey.’

Uno de los aspectos que más evidencian el hecho de que 2018 no ha logrado alcanzar las expectativas de la visión de 2001 es el de los viajes espaciales. Todavía no es algo normal hacer viajes rutinarios a distintas estaciones espaciales, ni las visitas a ninguna de las muchas bases que debería haber en la luna, ni tampoco viajamos a otros planetas. Pero Kubrick y Clarke sí que dieron en el blanco cuando imaginaron las distintas posibilidades, problemas y retos que plantearía el futuro de la inteligencia artificial.

¿Qué pueden hacer los ordenadores?

Uno de los principales conflictos de la película puede verse como una lucha a muerte entre un humano y un ordenador. La inteligencia artificial de 2001, encarnada por HAL, constituye una presencia computacional omnisciente, el cerebro de la nave Discovery One y, posiblemente, el personaje más famoso de la película. HAL representa el culmen de la computación: es un dispositivo con consciencia, aparentemente infalible, cuya presencia en la nave es ubicua; lo escucha todo y lo ve todo.

HAL no es un simple asistente tecnológico de la tripulación. Tal y como dice Dave Bowan, el comandante de la misión, HAL es el sexto miembro de la tripulación.

Los humanos hablan e interactúan con HAL, y él les responde con una voz masculina comedida, a medio camino entre la voz severa pero indulgente de un padre y la voz de un bienintencionado enfermero.

HAL es como Alexa y Siri, pero con el añadido de que HAL tiene total control sobre la nave y que, como se acaba sabiendo, es el único miembro de la tripulación que conoce el verdadero objetivo de la misión.

Ética en las máquinas

La tensión del tercer acto de la película gira en torno a cómo Bowman y su compañero de tripulación Frank Pool son cada vez más conscientes de que HAL no funciona correctamente, y cómo, por otro lado, HAL descubre sus sospechas. Dave y Frank quieren desconectar un ordenador defectuoso, pero HAL, que tiene consciencia propia, quiere vivir. En lo que sí coinciden es en que todos quieren llevar a término la misión.

Humano contra máquina.

El enfrentamiento a vida o muerte entre HAL y los humanos es precursor de algunas cuestiones actuales referentes al impacto de la prevalencia y el empleo de inteligencias artificiales en nuestras vidas diarias.

La primera cuestión, y la más importante, es cuánto control deberíamos ceder a una máquina con inteligencia artificial, sin importar lo “inteligente” que sea su sistema.

HAL, que controla la nave Discovery, es, en cierto modo, una versión espacial de las casas inteligentes del futuro o de los coches sin conductores.

Ciudadanos, políticos, expertos e investigadores siguen explorando el grado en el que la automatización podría, o debería, relevar a los humanos. Y aunque algunas de estas consideraciones tratan cuestiones relativamente simples sobre la fiabilidad de las máquinas, otras son bastante más delicadas.

Los actos de una máquina computacional son dictados por decisiones que los humanos codifican en algoritmos para controlar los dispositivos.

Los algoritmos, por lo general, tienen algún objetivo cuantificable hacia el que van progresando con cada una de sus acciones. Este objetivo puede ser, por ejemplo, ganar una partida a las damas o al ajedrez. Y, al igual que el sistema de una IA puede analizar las posiciones de las fichas de un tablero, también puede determinar la eficiencia de un almacén o el uso energético de un centro de datos.

Pero ¿qué ocurre cuando un dilema ético o moral se interpone en la consecución de un objetivo?

Para HAL, que tiene consciencia, terminar la misión y seguir con vida pesa más que las vidas del resto de tripulantes.

¿Qué pasa entonces con un coche sin conductor? En este caso, ¿cuál sería la prioridad de un coche autoconducido? ¿Sería, por ejemplo, llevar a un pasajero de un lugar a otro lo más rápido posible, o evitar matar a los peatones que se crucen en su camino? En el momento en que alguien se ponga delante de un vehículo autónomo, ese tipo de objetivos entrarán en conflicto. En este caso, parece que la “elección” que habría que programar es bastante obvia. Pero ¿qué pasaría si el coche tuviese que “elegir” entre dos posibles escenarios que resultaran, en ambos casos, en la muerte de una persona?

Bajo vigilancia

En una conocida escena, Dave y Frank acceden a una zona de la estación espacial donde piensan que HAL no podrá escucharles hablar sobre las dudas que tienen acerca de su estado y su capacidad para controlar la nave y dirigir la misión. Al final, acaban considerando la idea de apagarlo. Lo que no saben es que HAL puede verles a través de sus cámaras: el ordenador les lee los labios a través de una ventana y descubre sus planes.

HAL lee los labios.

En el mundo actual, una versión de esa escena ocurre cada día, y a todas horas. A la mayoría de nosotros nos monitorizan continuamente a través de nuestros teléfonos, que permanecen encendidos casi todo el tiempo, o a través del seguimiento de nuestras actividades en el mundo real y en la red por parte de gobiernos y corporaciones. Los límites entre lo público y lo privado son cada vez más difusos.

Las relaciones entre los personajes de la película me hicieron plantearme cómo podrían coexistir, o incluso evolucionar juntas, máquinas y personas.

En la mayor parte de la película se puede apreciar que hasta las conversaciones entre humanos resultan inexpresivas, carentes de tono o emoción. Hablan del mismo modo en que ellos hablarían a una máquina y una máquina les hablaría a ellos.

La famosa escena de la muerte de HAL en la que Dave desconecta metódicamente sus enlaces lógicos me hizo preguntarme si a las máquinas inteligentes se las llegará a permitir algún día tener algo equivalente a derechos humanos.

Clarke creía que la Tierra no sería para los humanos más que una “estancia temporal” y que la maduración y evolución de la especie llevará necesariamente a los humanos muy lejos de este planeta.

2001 tiene un final optimista: un humano atraviesa la Puerta de las Estrellas, marcando, así, el renacimiento de la especie. Pero para hacer esto en la realidad, tendremos que averiguar primero cómo hacer el mejor uso posible de las máquinas y los dispositivos que estamos construyendo y asegurarnos de no perder el control sobre ellos.

Descubre la nueva app de Cadena SER Te ofrecemos una mejor experiencia de audio y video

DescargarDaniel N. Rockmore, Professor, Department of Mathematics, Computational Science, and Computer Science, Dartmouth College

Este artículo fue publicado originalmente en The Conversation. Lea el original.